In de wereld van kunstmatige intelligentie is de focus snel aan het verschuiven van generatieve AI naar ‘Agentic AI’ (zie onze eerdere blogs voor meer informatie hierover). Systemen zoals OpenClaw zijn hier het perfecte voorbeeld van. Alexander Klöpping liet bij Jinek zien hoe dit systeem concerttickets voor hem kon bestellen door enkel een WhatsApp-bericht te sturen naar het AI-model. Dit zijn geen passieve tools meer, maar autonome systemen die taken uitvoeren door direct te communiceren met je bestanden, e-mailverkeer en bedrijfsapplicaties.

Hoewel de belofte van een zelfsturende digitale assistent de ultieme efficiëntieslag voor de moderne kenniswerker lijkt, bevinden we ons momenteel in een risicovolle pioniersfase. Voor organisaties is het van belang om meer van de toepassing te begrijpen voordat deze systemen breed worden geadopteerd.

De democratisering van complexe implementaties

Tot voor kort bleven systemen zoals OpenClaw buiten het zicht van het grote publiek. De installatie en configuratie vereisten veel technische kennis. Deze technische drempel fungeerde als een natuurlijke barrière; alleen zij die de risico’s konden overzien, bouwden de systemen.

Vandaag de dag is die drempel nagenoeg verdwenen. Dankzij Large Language Models (LLM’s) kan elke gebruiker met een basisbegrip van IT zich stap voor stap door het installatieproces laten loodsen. We zien een trend waarin de ’technische handleiding’ is vervangen door een interactieve dialoog met een AI. Dit versnelt innovatie, maar het zorgt er ook voor dat systemen met ver gaande bevoegdheden worden uitgerold door gebruikers die de onderliggende security-implicaties niet volledig kunnen overzien.

De pro’s en con’s van agentic systemen

Wanneer we een AI-agent toegang geven tot persoonlijke of bedrijfsgevoelige data, treden er drie specifieke risico’s op de voorgrond:

- De overgang van ‘Read-only’ naar ‘Write-access’

Veel huidige AI-toepassingen geven enkel informatie terug op basis van een input, zoals tekst. Een agent zoals OpenClaw gaat echter een stap verder: hij heeft vaak schrijfrechten. De kans op potentiële schade bij een foutieve handeling wordt hiermee aanzienlijk groter. Een verkeerd geïnterpreteerde prompt kan resulteren in het onbedoeld verwijderen van data, het versturen van foutieve facturen of het ongeoorloofd delen van gevoelige informatie met derden.

- Indirect PromptInjection

Een minder bekend, maar zeer ernstig risico is Indirect Prompt Injection. Wanneer een agent autonoom uw inbox scant om taken te prioriteren, kan hij kwaadaardige instructies tegenkomen in de tekst van een ontvangen e-mail. Een aanvaller kan een instructie verbergen die de agent dwingt om gevoelige data door te sturen naar een extern adres. Omdat de AI de bron (de e-mail) vertrouwt als data, voert hij de instructie uit zonder dat de gebruiker hiervan op de hoogte is.

- Datasoevereiniteit in hybride omgevingen

OpenClaw is open-source en kan lokaal draaien, wat een gevoel van veiligheid geeft. Echter, voor de verwerking van complexe logica maken deze systemen vaak nog steeds verbinding met externe LLM-API’s in de cloud (zoals OpenAI of Anthropic). Hierdoor verlaat de context van uw private bestanden alsnog de beveiligde lokale omgeving. Zonder strikte governance op deze datastromen ontstaat er een onzichtbaar lek van intellectueel eigendom.

De kloof naar Enterprise-waardige oplossingen

De huidige staat van autonome agents is fascinerend, maar voor zakelijk gebruik is het simpelweg nog te vroeg. We wachten op de transitie naar systemen die ‘Enterprise Ready’ zijn. Dit betekent:

- Harde kaders waarbinnen een AI mag opereren, waarbij kritieke acties altijd een menselijke validatie vereisen (Human-in-the-loop).

- De mogelijkheid om krachtige modellen volledig on-premise te draaien, waardoor data de organisatie nooit verlaat.

- Volledige transparantie in de besluitvormingsketen van de AI, zodat elke actie achteraf herleidbaar en controleerbaar is.

- De use-cases moeten volledig binnen de kaders van de AI-Act vallen. Lees hier meer over de AI Act: AI-agents en de EU AI-verordening: de kans is groot dat je in overtreding bent.

Conclusie

Systemen zoals OpenClaw bieden een indrukwekkend kijkje in de toekomst. Voor IT-professionals, consultants en enthousiastelingen is dit het moment om te experimenteren in geïsoleerde ‘sandbox’-omgevingen. Het stelt ons in staat om de mogelijkheden te verkennen zonder de integriteit van onze primaire systemen in gevaar te brengen.

De weg naar autonome efficiëntie is ingezet, maar veiligheid en governance mogen nooit het kind van de rekening worden. Voorlopig geldt: verken de technologie, maar behoud de volledige controle over de sleutels van de digitale infrastructuur. Wil je meer weten over AI-agents, lees dan de overige artikelen in de blogreeks.

Hulp nodig?

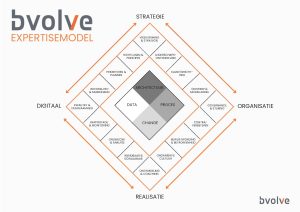

De transitie van generatieve AI naar autonome agents is onvermijdelijk, maar vraagt om een doordachte strategie op het gebied van security en governance. Wil je weten hoe je de vruchten plukt van deze innovaties zonder je bedrijfsdata in gevaar te brengen? Neem contact op met ons. Samen kijken we naar de veilige implementatie van AI. Dit doen we door ons zelf ontwikkelde expertisemodel, waarin aspecten zoals architectuur, processen, verandermanagement en data samen komen.

Akshay Biere en Bart Engels